Amazon & OpenAI: “Bắt Tay” AI 50 Tỷ Đô – Anh Em Kỹ Thuật Lưu Ý!

Amazon & OpenAI: Cái Bắt Tay $50 Tỷ Đô và Tương Lai Phần Cứng AI – Anh Em Kỹ Thuật Cần Quan Tâm Điều Gì?

Thỏa thuận 50 tỷ USD giữa Amazon và OpenAI không chỉ là một con số, nó là một cú dịch chuyển kiến tạo đang định hình lại toàn bộ sân chơi phần cứng AI toàn cầu. Tạm gác lại những phân tích tài chính vĩ mô, điều mà anh em kỹ thuật, quản trị hệ thống, hay những người đang trực tiếp “sờ” vào hạ tầng máy chủ cần thực sự chú ý, chính là cam kết của OpenAI sẽ sử dụng một nguồn lực khổng lồ: 2 gigawatt (GW) điện cho dàn chip AI “nhà trồng” của Amazon – Trainium.

Đây không còn là một phép thử. Động thái này là một tín hiệu rõ ràng rằng thế độc tôn của Nvidia trong mảng phần cứng AI đang bị thách thức nghiêm túc. Một tương lai hạ tầng đa dạng hơn, linh hoạt hơn và quan trọng là kinh tế hơn đang mở ra, nơi chúng ta không còn bị trói buộc vào một nhà cung cấp duy nhất.

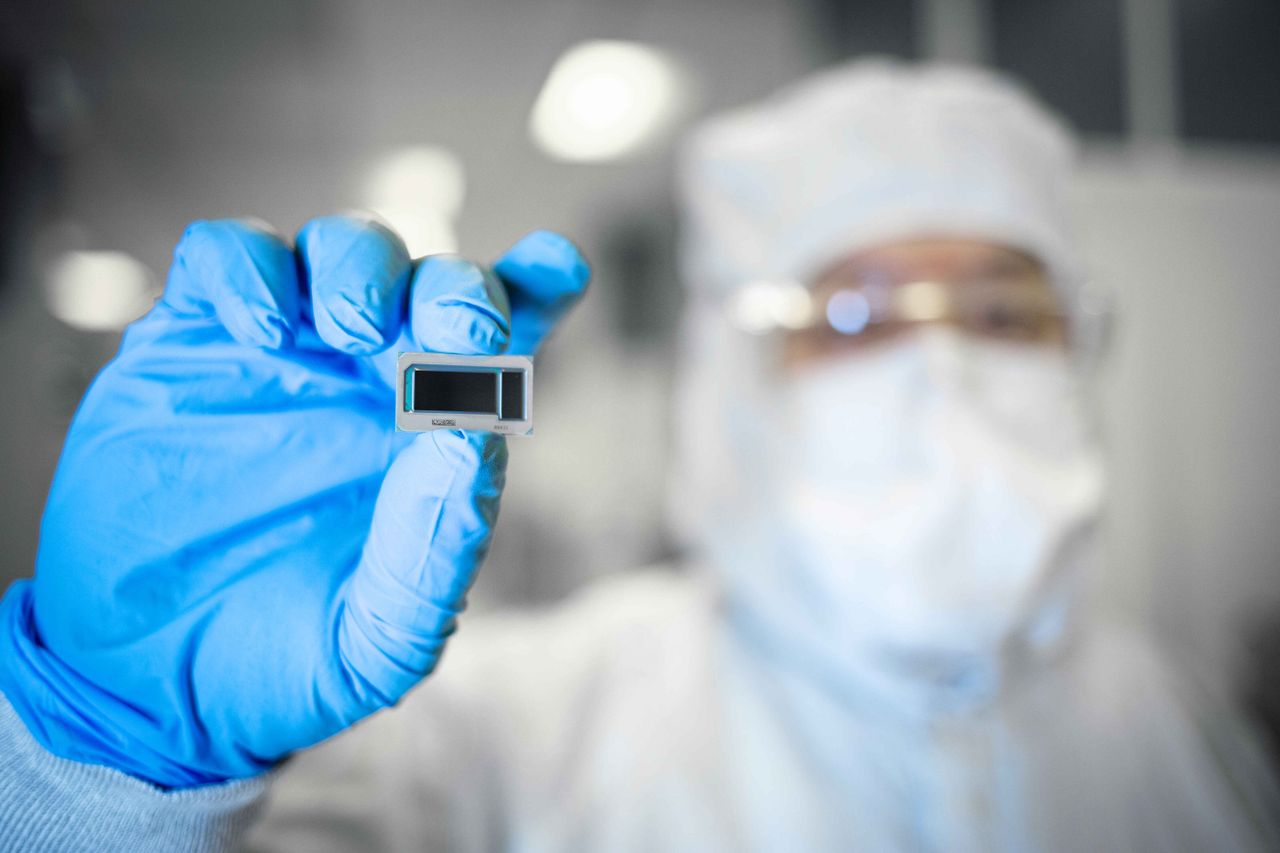

Chip Amazon Trainium – Kẻ thách thức thực sự của GPU Nvidia đã lộ diện

Từ lâu, Nvidia đã là cái tên mặc định khi nói về chip AI hiệu năng cao. Tuy nhiên, sự trỗi dậy của Amazon Trainium đang viết lại câu chuyện này. Đây là dòng chip chuyên dụng (ASIC) do chính Amazon tự thiết kế, được “đo ni đóng giày” cho các tác vụ huấn luyện (training) và suy luận (inference) AI, thay vì là một GPU đa mục đích.

Thế hệ Trainium 3 mới nhất được công bố với hiệu năng cao hơn 4 lần và hiệu quả năng lượng tốt hơn 40% so với thế hệ trước. Nhưng con số thực sự “biết nói” với giới kỹ thuật là tuyên bố từ AWS: Trainium giúp tiết kiệm từ 30-40% chi phí so với việc dùng cấu hình GPU Nvidia tương đương. Trong bối cảnh chi phí điện và vận hành datacenter ngày càng phình to, đây là một yếu tố có sức nặng quyết định.

Việc OpenAI – một trong những tổ chức AI tiên phong và đòi hỏi khắt khe nhất thế giới – đặt cược vào 2 GW chip Trainium không chỉ là một đơn hàng lớn. Nó là lời bảo chứng đanh thép nhất cho hiệu năng và sự ổn định của nền tảng này. Trainium đã chứng tỏ mình đủ sức gánh vác những workload AI nặng nề và phức tạp nhất. Nó giống như khi bạn chọn một bộ nguồn chuẩn 80 Plus Titanium cho dàn server quan trọng nhất của mình – đó là sự đầu tư vào độ tin cậy và hiệu suất bền vững.

Chìa Khóa Tương Thích: Trainium 4 Sẽ “Nói Chuyện” Trực Tiếp Với Nvidia Bằng NVLink Fusion

Đây có lẽ là thông tin đáng giá và thực tế nhất đối với cộng đồng kỹ thuật. Thế hệ chip Trainium 4 sắp tới của Amazon được thiết kế để hỗ trợ chuẩn kết nối NVLink Fusion của Nvidia.

Nói một cách đơn giản: Các hệ thống chạy chip Trainium 4 có thể giao tiếp, kết nối và hoạt động **chung trong cùng một tủ rack** với các GPU Nvidia. Đây là một bước đi cực kỳ khôn ngoan, giải quyết bài toán cố hữu và đau đầu nhất: sự phụ thuộc vào hệ sinh thái phần mềm CUDA độc quyền của Nvidia.

Hãy hình dung NVLink Fusion như một chuẩn giao tiếp chung, một “cao tốc liên mạng” cho phép chip Trainium và GPU Nvidia trao đổi dữ liệu mượt mà như một. Điều này có nghĩa là doanh nghiệp không còn phải đánh cược tất cả vào một hệ sinh thái. Thay vào đó, chúng ta có thể xây dựng một hạ tầng lai (hybrid) linh hoạt, tận dụng thế mạnh của cả hai nền tảng mà không cần viết lại code hay đầu tư vào hai hệ thống hoàn toàn tách biệt. Khả năng tương thích sâu này mang lại sự tự do trong thiết kế hệ thống, giúp tối ưu hóa cả hiệu suất lẫn chi phí đầu tư.

Phân chia lại sân chơi: AWS lo mảng Doanh nghiệp, Azure giữ mảng API

Cú bắt tay này không loại Microsoft ra khỏi cuộc chơi, mà phân định lại vai trò một cách rõ ràng. Azure của Microsoft vẫn là nhà cung cấp đám mây độc quyền cho các lệnh gọi API “stateless” (không trạng thái) của OpenAI. Tức là các tác vụ AI ngắn, không cần nhớ ngữ cảnh giữa các lần gọi, sẽ vẫn chạy trên hạ tầng Azure.

Ngược lại, AWS sẽ là nhà phân phối độc quyền cho Frontier – nền tảng AI agent dành cho doanh nghiệp của OpenAI. Vị thế này đặt AWS làm đối tác chiến lược cho các giải pháp AI phức tạp, đòi hỏi tính liên tục và khả năng lưu trữ trạng thái.

Điểm sáng kỹ thuật ở đây là sự hợp tác phát triển “Stateful Runtime Environment” (SRE). Đây là môi trường thực thi “có trạng thái”, cho phép các AI agent lưu trữ bộ nhớ và ngữ cảnh qua nhiều phiên làm việc, thay vì bị “reset” sau mỗi lần tương tác. Đây là một bước tiến quan trọng về mặt kiến trúc, giúp AI agent thực sự thông minh và hữu dụng hơn trong các bài toán doanh nghiệp. Với SRE, anh em kỹ thuật có thể xây dựng những ứng dụng đột phá, từ tự động hóa quy trình nghiệp vụ phức tạp đến các trợ lý ảo có khả năng “nhớ” và học hỏi thực sự.

Thương vụ Amazon-OpenAI là lời khẳng định đanh thép cho xu hướng đa dạng hóa phần cứng AI. Tương lai của trung tâm dữ liệu không còn là sân chơi của riêng Nvidia, mà là một hệ sinh thái mở, nơi nhiều giải pháp cùng tồn tại và bổ trợ cho nhau.

Dưới góc độ kỹ thuật, điều đáng giá nhất là cách tiếp cận khôn ngoan của Amazon: chọn “sống chung” và tích hợp với Nvidia qua NVLink, thay vì đối đầu trực diện. Đây là một chiến lược thực tế, tập trung vào việc tạo ra giải pháp linh hoạt và hiệu quả nhất cho người dùng cuối, thay vì ép họ vào một hệ sinh thái đóng.

Sự bùng nổ của các trung tâm dữ liệu quy mô hàng gigawatt này một lần nữa khẳng định tầm quan trọng cốt lõi của hạ tầng kết nối vật lý. Từ cáp mạng, cáp quang tốc độ cao đến các giải pháp cấp nguồn ổn định như dây nguồn C13, C19, thanh nguồn PDU, mọi chi tiết dù là nhỏ nhất đều ảnh hưởng trực tiếp đến hiệu năng và độ tin cậy của cả một hệ thống triệu đô. Để xây dựng một hạ tầng AI vững chắc cho tương lai, hãy bắt đầu từ những nền tảng đáng tin cậy nhất. Ghé thăm **Kho Sỉ Phụ Kiện** để tìm kiếm các giải pháp kết nối chuyên dụng và phụ kiện máy chủ chất lượng cao, được các chuyên gia tin dùng.

#AmazonAI, #OpenAI, #Trainium, #Nvidia, #NVLinkFusion