AI và Linux Kernel: Linus Torvalds Chốt Hạ “Luật Chơi” Mới!

Trí Tuệ Nhân Tạo (AI) và Mã Nguồn Linux Kernel: Luật Chơi Mới Cho Kỷ Nguyên Phát Triển Phần Mềm

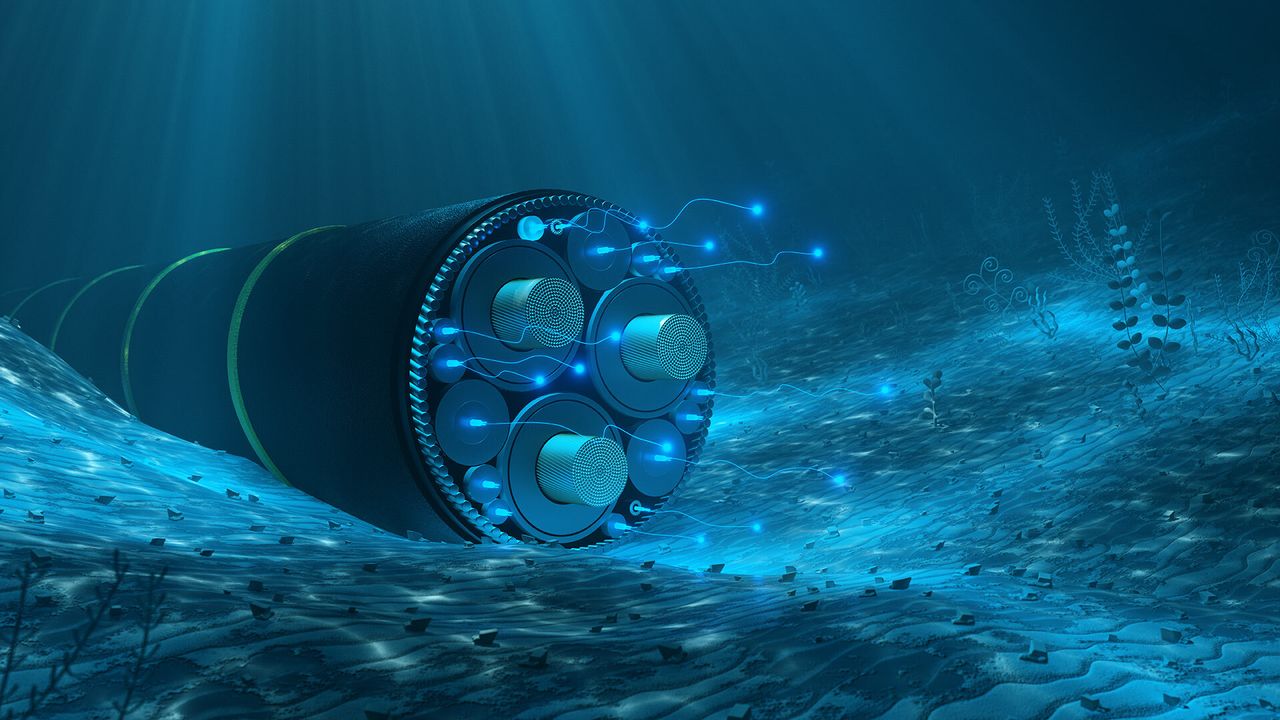

AI đang thay đổi mọi ngóc ngách, từ sản xuất đến dịch vụ, và thế giới phát triển phần mềm cũng không ngoại lệ. Từ tự động hóa các tác vụ nhàm chán đến việc sinh ra những đoạn mã phức tạp, AI mở ra vô vàn khả năng mới. Thế nhưng, một câu hỏi lớn đặt ra là: Liệu mã nguồn do AI tạo ra có đáng tin cậy để đưa vào các hệ thống quan trọng, đặc biệt là Linux Kernel – “trái tim” của hàng triệu máy chủ, thiết bị nhúng và nhiều nền tảng công nghệ toàn cầu?

Sau nhiều tháng tranh cãi nảy lửa và cân nhắc kỹ lưỡng từ cộng đồng, Linus Torvalds cùng các nhà bảo trì Linux Kernel cuối cùng đã công bố “luật chơi” rõ ràng cho những đoạn mã có sự tham gia của AI. Quyết định này không phải là cấm cản, mà là chấp nhận AI như một công cụ hỗ trợ phát triển, nhưng với một điều kiện tiên quyết: con người phải chịu trách nhiệm hoàn toàn cho mọi đóng góp.

Dù bạn là kỹ thuật viên IT, thợ sửa máy hay chỉ là người dùng văn phòng bình thường, sự ổn định của hệ thống luôn là ưu tiên hàng đầu. Chính sách mới của Linux Kernel ảnh hưởng trực tiếp đến chất lượng, độ bảo mật của nền tảng chúng ta dùng hàng ngày, và sẽ định hình cách phát triển phần mềm trong tương lai. Sự minh bạch về nguồn gốc mã nguồn không chỉ là yếu tố sống còn để đảm bảo hệ thống ổn định và bảo mật, mà còn là nền tảng vững chắc cho sự tin cậy lâu dài. Chúng tôi hiểu bạn cần một hệ thống chạy bền bỉ, và quy định này chính là một bước tiến quan trọng để hiện thực hóa điều đó.

Chính sách mới: Minh bạch là trên hết, trách nhiệm là của con người

Quyết định của Linux Kernel đánh dấu một bước ngoặt quan trọng trong cách cộng đồng mã nguồn mở tiếp cận công nghệ AI. Thay vì cấm hoàn toàn, họ chọn một hướng đi thực dụng và minh bạch: Linux Kernel chính thức cho phép các nhà phát triển đóng góp mã nguồn có sự hỗ trợ của AI, nhưng đi kèm với những quy tắc rõ ràng và nghiêm ngặt.

- Khai báo rõ ràng bằng thẻ “Assisted-by”: Thay vì dùng thẻ “Signed-off-by” truyền thống (vốn là một cam kết pháp lý về bản quyền và quyền sở hữu), giờ đây các đóng góp có sự hỗ trợ của AI phải dùng thẻ mới “Assisted-by”. Điều này giúp cộng đồng dễ dàng nhận diện các đoạn mã do AI tạo ra hoặc chỉnh sửa, đảm bảo minh bạch về nguồn gốc. Thẻ “Signed-off-by” yêu cầu người đóng góp xác nhận họ có quyền hợp pháp đóng góp mã theo giấy phép của dự án. Với “Assisted-by”, ranh giới trách nhiệm pháp lý rõ ràng hơn nhiều.

- Trách nhiệm hoàn toàn thuộc về con người: Đây là yếu tố then chốt của chính sách này. Mọi lỗi, lỗ hổng bảo mật hay vấn đề pháp lý phát sinh từ mã AI đều quy về trách nhiệm của nhà phát triển (con người) đã gửi nó. AI chỉ là một công cụ, không phải một thực thể có thể đứng ra chịu trách nhiệm pháp lý. Điều này buộc các kỹ sư phải kiểm tra, xác minh và hiểu rõ từng dòng mã AI đề xuất, như thể chính tay họ viết ra.

- Quan điểm của Linus Torvalds: “Cha đẻ” của Linux Kernel luôn giữ quan điểm rất thực tế. Ông khẳng định AI cũng chỉ là một công cụ, chẳng khác gì trình biên dịch, trình gỡ lỗi hay các môi trường phát triển tích hợp (IDE) khác. Cấm đoán công cụ này là “vô nghĩa”. Thay vào đó, trọng tâm cần đặt vào việc quản lý trách nhiệm của người dùng công cụ đó. Mục tiêu cuối cùng vẫn là chất lượng và sự an toàn của mã nguồn, bất kể nó được tạo ra bằng cách nào đi nữa.

Những thách thức từ “AI Slop” và vấn đề bản quyền đã định hình chính sách mới của Linux Kernel

Trước khi chính sách mới được ban hành, cộng đồng mã nguồn mở đã phải đối mặt với nhiều thách thức và tranh cãi gay gắt liên quan đến việc sử dụng AI trong phát triển phần mềm. Điều này đã định hình mạnh mẽ cách Linux Kernel tiếp cận vấn đề.

- Lo ngại về bản quyền và tính hợp pháp: Nhiều dự án mã nguồn mở lớn như Gentoo và NetBSD từng cấm một phần hoặc toàn bộ mã AI. Lý do chính là lo ngại sâu sắc về bản quyền và tính hợp pháp của dữ liệu dùng để đào tạo các mô hình AI. Red Hat, một trong những ông lớn đóng góp cho Linux, từng cảnh báo rằng Developer Certificate of Origin (DCO) yêu cầu người đóng góp xác nhận quyền hợp pháp đối với mã họ gửi. Mã do AI tạo ra, vốn được đào tạo trên kho dữ liệu khổng lồ với vô số giấy phép khác nhau (ví dụ: GPL, MIT, Apache), có thể vô tình vi phạm bản quyền hoặc kéo theo những cam kết giấy phép phức tạp mà nhà phát triển không thể lường trước. Đây là một rủi ro cực lớn cho các dự án mã nguồn mở.

- Thực trạng “AI slop” – mã AI chất lượng thấp: Một thách thức khác là sự xuất hiện của “AI slop” – thuật ngữ chỉ những đoạn mã do AI tạo ra một cách hời hợt, kém chất lượng, đôi khi là “ảo giác” (tạo ra mã sai nhưng lại rất tự tin), hoặc không phù hợp với mục đích ban đầu. Các dự án mã nguồn mở lớn nhận hàng ngàn đóng góp mỗi ngày. Khi những đóng góp này tràn ngập mã AI chất lượng thấp, việc kiểm duyệt và duy trì chất lượng trở nên tốn thời gian, công sức khủng khiếp, buộc một số dự án phải đóng tạm thời các kênh đóng góp để xử lý.

- Những trường hợp điển hình gây mất lòng tin: Cộng đồng từng chứng kiến nhiều trường hợp gây tranh cãi gay gắt. Điển hình là việc Sasha Levin (nhà phát triển từ NVIDIA, từng là nhà bảo trì Linux Kernel) và Christoph “Graf Zahl” Oelckers (nhà phát triển chính của GZDoom) bị cộng đồng phản đối kịch liệt vì dùng mã AI mà không minh bạch. Việc này không chỉ gây ra vấn đề chất lượng mã mà còn làm mất niềm tin của cộng đồng, vốn là yếu tố sống còn cho các dự án mã nguồn mở. Nó cho thấy minh bạch không chỉ là yêu cầu kỹ thuật mà còn là nền tảng đạo đức cốt lõi trong cộng đồng phát triển.

Quan điểm thực dụng của Linux: Tập trung vào chất lượng, không phải công cụ

Triết lý cốt lõi đằng sau quyết định của Linux Kernel chính là sự thực dụng. Linus Torvalds luôn khẳng định AI cũng chỉ là một công cụ như bao công cụ khác mà kỹ sư phần mềm dùng hàng ngày. Từ trình biên dịch C, trình gỡ lỗi GDB, đến các trình chỉnh sửa văn bản như Vim hay Emacs – tất cả đều là công cụ hỗ trợ con người. Vì thế, cấm đoán một công cụ như AI là “vô nghĩa” và đi ngược lại tinh thần đổi mới.

- Không kiểm soát công cụ, chỉ kiểm soát đầu ra: Thay vì cố gắng kiểm soát phần mềm nào cài trên máy của nhà phát triển hay cách họ tạo mã, chính sách mới tập trung hoàn toàn vào đầu ra: chính mã nguồn. Nghĩa là, dù bạn dùng AI để tạo ra một hàm, một module hay chỉ để gợi ý sửa lỗi, mã đó phải đáp ứng các tiêu chuẩn chất lượng cao nhất của Linux Kernel. Mã phải tốt, ổn định và an toàn, như thể chính con người viết ra nó.

-

Cơ chế răn đe mạnh mẽ: Để đảm bảo chất lượng và ngăn chặn “AI slop”, Linux Kernel áp dụng một cơ chế răn đe cực kỳ mạnh mẽ. Nếu mã do AI hỗ trợ (hoặc bất kỳ mã nào khác) gây lỗi nghiêm trọng, kém chất lượng hoặc không đạt tiêu chuẩn, người gửi sẽ phải chịu trách nhiệm trực tiếp với Linus Torvalds và toàn bộ cộng đồng phát triển. Hậu quả thì không hề nhỏ chút nào:

- Từ chối vá lỗi: Các bản vá lỗi (patch) kém chất lượng có thể bị từ chối thẳng thừng, làm chậm trễ việc tích hợp tính năng hoặc sửa lỗi.

- Giảm ưu tiên đóng góp: Uy tín của nhà phát triển sẽ bị ảnh hưởng nghiêm trọng. Những đóng góp sau này có thể bị soi xét kỹ lưỡng hơn, hoặc bị giảm ưu tiên trong hàng đợi kiểm duyệt.

- Cấm khỏi danh sách gửi thư (mailing list): Trong những trường hợp cực kỳ nghiêm trọng, một nhà phát triển có thể bị cấm hoàn toàn khỏi danh sách gửi thư chính của Linux Kernel – nơi mọi hoạt động phát triển diễn ra. Điều này ảnh hưởng nghiêm trọng đến uy tín, khả năng hợp tác và thậm chí là sự nghiệp của kỹ sư phần mềm.

Cơ chế này đảm bảo mỗi nhà phát triển, dù dùng AI hay không, đều phải chịu trách nhiệm cá nhân và chuyên nghiệp cho chất lượng của từng dòng mã họ đóng góp.

Duy Trì Độ Ổn Định và Tin Cậy Cho Hệ Thống Cốt Lõi

Chính sách mới của Linux Kernel thể hiện một cách tiếp cận vừa thực dụng, vừa vô cùng thông minh. Nó cân bằng giữa việc tận dụng tiềm năng khổng lồ của AI để tăng tốc phát triển và duy trì chất lượng, an toàn của một hệ thống cốt lõi quan trọng bậc nhất thế giới. Bằng cách đặt trách nhiệm pháp lý và chất lượng hoàn toàn lên vai con người, Linux Kernel thúc đẩy minh bạch và kiểm soát chặt chẽ các đóng góp mã nguồn, đảm bảo rằng đổi mới không đánh đổi bằng sự ổn định.

Chúng tôi tin đây là một bước đi thông minh và cần thiết trong bối cảnh công nghệ phát triển nhanh như vũ bão. Quyết định này không chỉ khẳng định vai trò không thể thay thế của kỹ sư con người trong việc đảm bảo tính toàn vẹn và độ tin cậy của phần mềm cốt lõi, mà còn là một bài học đắt giá về cách chúng ta nên tích hợp các công nghệ mới vào quy trình làm việc. Sự tin cậy này không chỉ dừng lại ở mã nguồn, mà còn lan tỏa đến mọi thành phần của hệ thống máy tính, từ phần mềm đến phần cứng.

Để một hệ thống vận hành trơn tru và ổn định, cả phần mềm (như Linux Kernel với những quy định chặt chẽ này) lẫn phần cứng đều phải đáng tin cậy. Tại Kho sỉ Phụ kiện (KSPK), chúng tôi hiểu rằng sự ổn định toàn diện chính là chìa khóa vận hành mọi hệ thống. Dù bạn là kỹ thuật viên IT đang xây dựng máy chủ “khủng”, hay chỉ là dân văn phòng cần một chiếc máy tính chạy bền bỉ không ngừng nghỉ, việc chọn đúng phụ kiện chất lượng là vô cùng quan trọng. Những giải pháp kết nối màn hình như cáp VGA, HDMI, DVI chất lượng cao, với chuẩn kết nối phù hợp (ví dụ: dây HDMI “xịn” cho độ phân giải sắc nét, đầu chuyển VGA cho màn hình cũ để đảm bảo tương thích), hay dây nguồn SATA/IDE đủ tải và ổn định cho ổ cứng cùng các linh kiện khác, đều là những yếu tố không thể thiếu.

Tại KSPK, chúng tôi cam kết mang đến các phụ kiện tương thích cao, đảm bảo truyền tải dữ liệu ổn định và cung cấp năng lượng tối ưu, giúp bạn – dù là kỹ thuật viên IT hay người dùng văn phòng – đạt được sự ổn định tuyệt đối trong công việc hàng ngày. Ghé thăm website của KSPK ngay hôm nay để khám phá những sản phẩm chất lượng hàng đầu, hỗ trợ hệ thống của bạn hoạt động bền bỉ và tối ưu nhất!

#AI,#LinuxKernel,#MãNguồn,#PhátTriểnPhầnMềm,#LinusTorvalds

Biên dịch và tổng hợp từ Website Tomshardware.com: Link bài viết